Подход с учетом привычки агента

Далее теоретические моменты приравниваются к выборочным, то есть к эмпирическим. В общем случае для линейной регрессии вида или в векторном виде, где матрица имеет размерность (nЧ1), матрица Х — (nЧk), а матрица — (kЧ1), моментные условия можно записать как, где Т — символ транспонирования. При условии, что матрица — невырожденная, решением уравнения будет (Слуцкин, 2007). Учитывая, что в данной… Читать ещё >

Подход с учетом привычки агента (реферат, курсовая, диплом, контрольная)

В данной работе для решения загадки премии по акциям применялся подход с учетом привычки агента как наиболее популярный метод в научной литературе.

Привычка задавалась как потребление по отношению к предыдущему «эталонному» уровню потребления. Это предположение является логичным с той точки зрения, что агенты стремятся сгладить свое потребление. Они боятся, что может возникнуть ситуация, когда им придется резко сократить потребление по отношению к какому-то прошлому периоду.

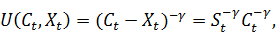

Степенная функция полезности для модели будет выглядеть как уравнение (3), где — это уровень внешне заданной привычки агента. Его предельная полезность может быть выражена как:

(9).

где:

— соотношение излишка потребления.

Тогда межвременная норма предельного замещения будет определена следующим образом:

(10).

где:

— межвременной дисконтирующий фактор;

— коэффициент риск-аверсии.

Теперь, исходя из уравнения (10) могут быть найдены моменты для предельной нормы замещения с помощью метода GMM (Campbell, Cochrane, 1999). Суть метода заключается в том, что для оценки параметров модели вместо математических ожиданий рассчитываются моменты. Затем минимизируется матрица, в которой используются полученные моменты. Причина использования метода в данной работе заключается в том, что он позволяет использовать структурную форму модели. Кроме того, метод разрешает использовать больше ограничений, чем оцениваемых параметров. Поэтому, при его использовании важно проводить тест на сверхидентифицированность (J-тест), т.к. из-за сверхидентифицированности модели могут быть получены неоднозначные оценки коэффициентов. Если значение Хи-квадрат статистики на заданном уровне значимости больше полученной J-статистики, то модель принимается.

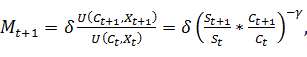

Если говорить более подробно, то для применения обобщенного метода моментов сначала подбираются моментные условия для оценки параметров. Большим плюсом данного метода является необязательность выполнения предпосылок о нормальности распределения, гомоскедастичности и отсутствии автокорреляции остатков, однако должно выполняться условие об одинаковости математических ожиданий случайных величин. Здесь следует вспомнить, что математическое ожидание случайной величины называется моментом первого порядка, а ее выборочным моментом называется выборочное среднее. Так, для функции g (x) момент (теоретический) и выборочный момент будут соответственно:

(11).

где:

— количество наблюдений;

— случайные величины.

Обычно функция g (x) зависит от параметров, где k —количество оцениваемых параметров, следовательно, моменты также будут зависеть от параметров. Следует отметить, что если k меньше количества моментных условий, то система одновременных уравнений не разрешима, если k больше их, то система называется сверхидентифицированной, когда количество параметров равно количеству моментных условий, то система называется идентифицированной.

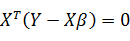

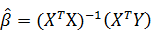

Далее теоретические моменты приравниваются к выборочным, то есть к эмпирическим. В общем случае для линейной регрессии вида или в векторном виде, где матрица имеет размерность (nЧ1), матрица Х — (nЧk), а матрица — (kЧ1), моментные условия можно записать как, где Т — символ транспонирования. При условии, что матрица — невырожденная, решением уравнения будет (Слуцкин, 2007).

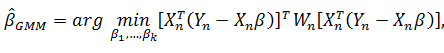

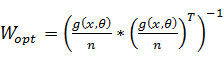

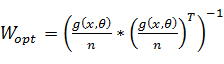

Учитывая, что в данной работе использовалась сверхидентифицированная система, которая обычно не имеет решения, то следующим шагом в качестве оценки, полученной обобщенным методом моментов, используется вектор моментных условий, наиболее приближенный к нулю для минимизации квадратичной формы (Гельман, Шпренгер, 2014). Тогда оценка будет выглядеть следующим образом:

(12).

где:

— произвольная симметричная положительно определенная матрица порядка n (матрица весов);

— матрица, зависящая от эндогенных и инструментальных переменных.

Полученные оценки будут состоятельными, но неэффективными, так как количество оцениваемых параметров меньше чем количество условий. Для получения асимптотически эффективных оценок сначала находится гетероскедастичные автокорреляционные состоятельные (ГАС) оценки с помощью процедур Хансена-Уайта (Hansen-White estimator), Ньюи-Уэста (Newey-West estimator) или других (Слуцкин, 2007), а затем подставляется в уравнение (12), которое переоценивается. Данная процедура продолжается до конвергенции (Гельман, Шпренгер, 2014).

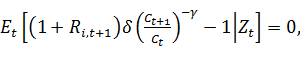

Для модели C-CAPM оценивается уравнение Эйлера в качестве условия первого порядка, которое может быть записано как:

(13).

где:

— вектор инструментальных переменных (IV);

Левую часть уравнения (13) можно также назвать случайным членом, условное среднее которого равно нулю.

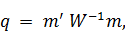

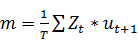

Затем минимизируется квадратичная форма q путем нахождения таких оценок, которые приближают вектор выборочных условий ортогональности к нулю:

(14).

где:

— вектор выборочных условий ортогональности; ;

Т — количество периодов времени;

— положительно определенная матрица весов.

От матрицы весов зависит эффективность оценок, поэтому для получения наилучших результатов необходимо найти оптимальную матрицу. Также оптимальная матрица весов должна давать наименьшую асимптотическую ковариационную матрицу. Такая матрица весов равна обратной ковариационной матрице выборочных моментов: (Verbeek, 2008).

В нашей работе будут рассчитываться одношаговый и итеративный GMM. Оба метода имеют одинаковые асимптотические свойства, однако считается, что итеративный метод лучше работает на малых выборках, что важно для нашей работы, т.к. данные по российскому фондовому рынку доступны только за 18 лет.